Ansvarlig AI i praksis

Efterhånden som AI-systemer i stigende grad understøtter beslutningstagning, vidensarbejde og softwareudvikling, handler spørgsmålet ikke længere kun om, hvad teknologien kan – men også om, hvordan den bør forstås og om hvordan den kan anvendes ansvarligt. Særligt de såkaldte AI-fundamentalmodeller – store generelle AI-systemer trænet på enorme mængder data – rejser nye etiske spørgsmål om miljøbelastning, magtkoncentration, krænkelse af privatliv, diskrimination, usikkerhed, risiko og organisatorisk ansvar. Workshoppen introducerer, hvad disse AI-modeller er – og hvad de ikke er – og sætter fokus på de etiske spørgsmål og moralske dilemmaer, de rejser. Med afsæt i debatten om nyere AI-systemer diskuteres samtidig, hvilke organisatoriske og ledelsesmæssige værktøjer og praksisser der kan bringes i spil, når de moralske problemer skal identificeres, vurderes og håndteres. Med afsæt i videnskabsteori, AI-etik og praktisk erfaring med AI-systemer præsenteres deltagerne for konkrete etiske dilemmaer og arbejder i grupper med forskellige rammer for AI governance. Workshoppen afsluttes med en åben dialog om balancen mellem ansvarlig AI-ledelse og styring på den ene side – og innovation, eksperimentering og kreativ anvendelse på den anden.

Forståelse af hvad AI-systemer faktisk er

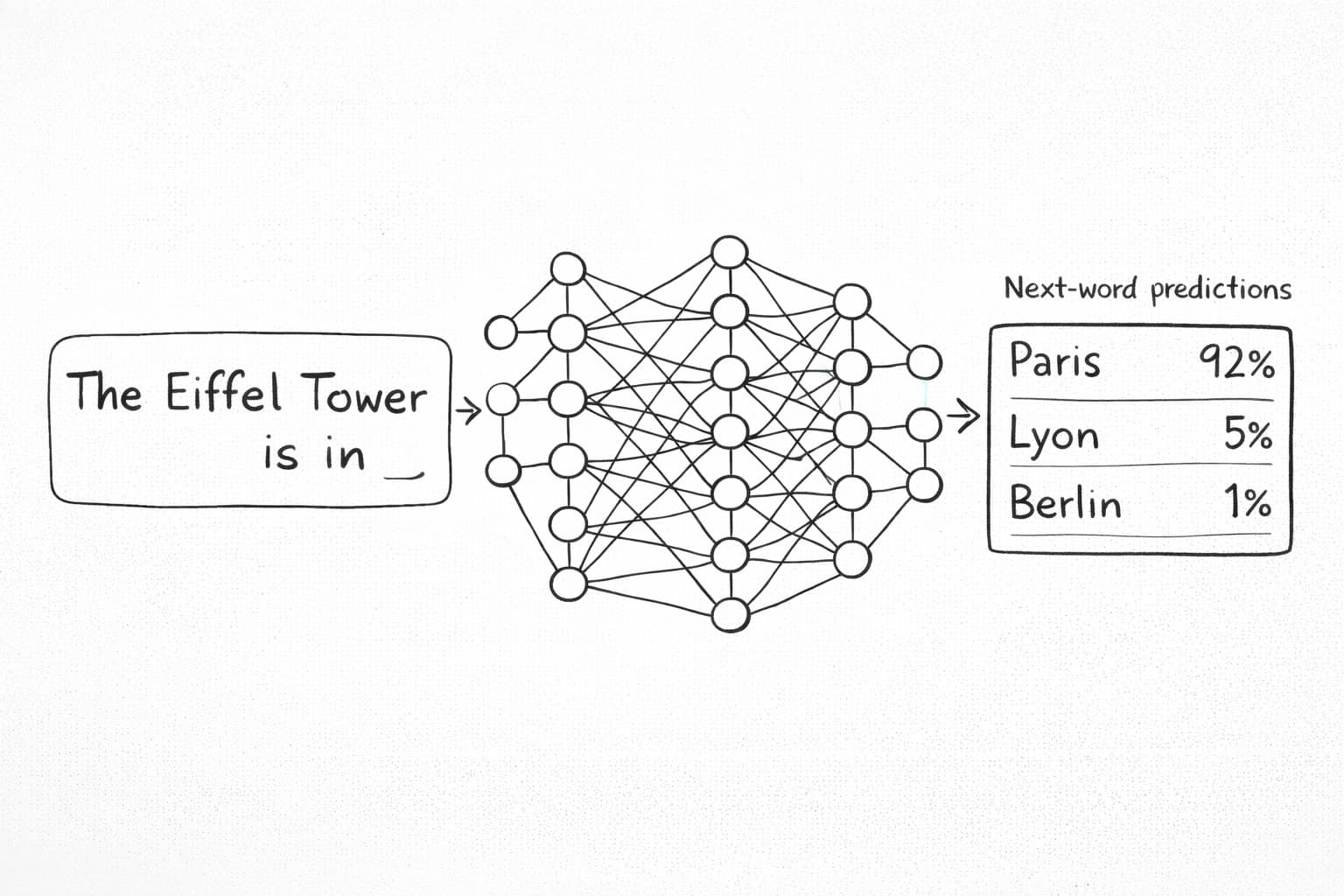

Før vi kan bruge AI ansvarligt, må vi forstå, hvad vi arbejder med. Særligt Large Language Models (LLM) er ikke systemer med egentlig forståelse. De er probabilistiske modeller, det vil sige trænet til at forudsige det næste ord i en tekst med en hvis sandsynlighed. Deres svar er derfor statistisk sandsynlige fortsættelser af sprogmønstre i træningsdata. Det betyder, at når fx læger, rekrutteringsspecialister, finansielle rådgivere, advokater bruger AI-svar, kan de få mange både korrekte og anvendelige svar, samtidig med at de let kan blive vildledt af falske overbevisende formuleringer, da et AI-svar ikke er et sikkert faktum. Det er et sandsynligt sprogligt resultat, genereret ud fra mønstre i data. Et AI-svar kan være et resultat af det man kalder hallucinationer. Modellen kan producere udsagn, der lyder plausible, men som er opdigtede, upræcise, falske eller diskriminerende. Det er en konsekvens af modellens probabilistiske karakter. Det er ikke kun det svar modellen producere, men også de ting modellen undlader at sige, der kan få alvorlige konsekvenser. Deltagerne arbejder med eksempler fra AI-udvikling og vidensarbejde. Fokus er praktisk: hvordan man vurderer et AI-svar, hvornår man skal verificere det, og hvordan man designer arbejdsprocesser, der håndterer usikkerhed eksplicit.

AI-etik i dagligt teknisk arbejde

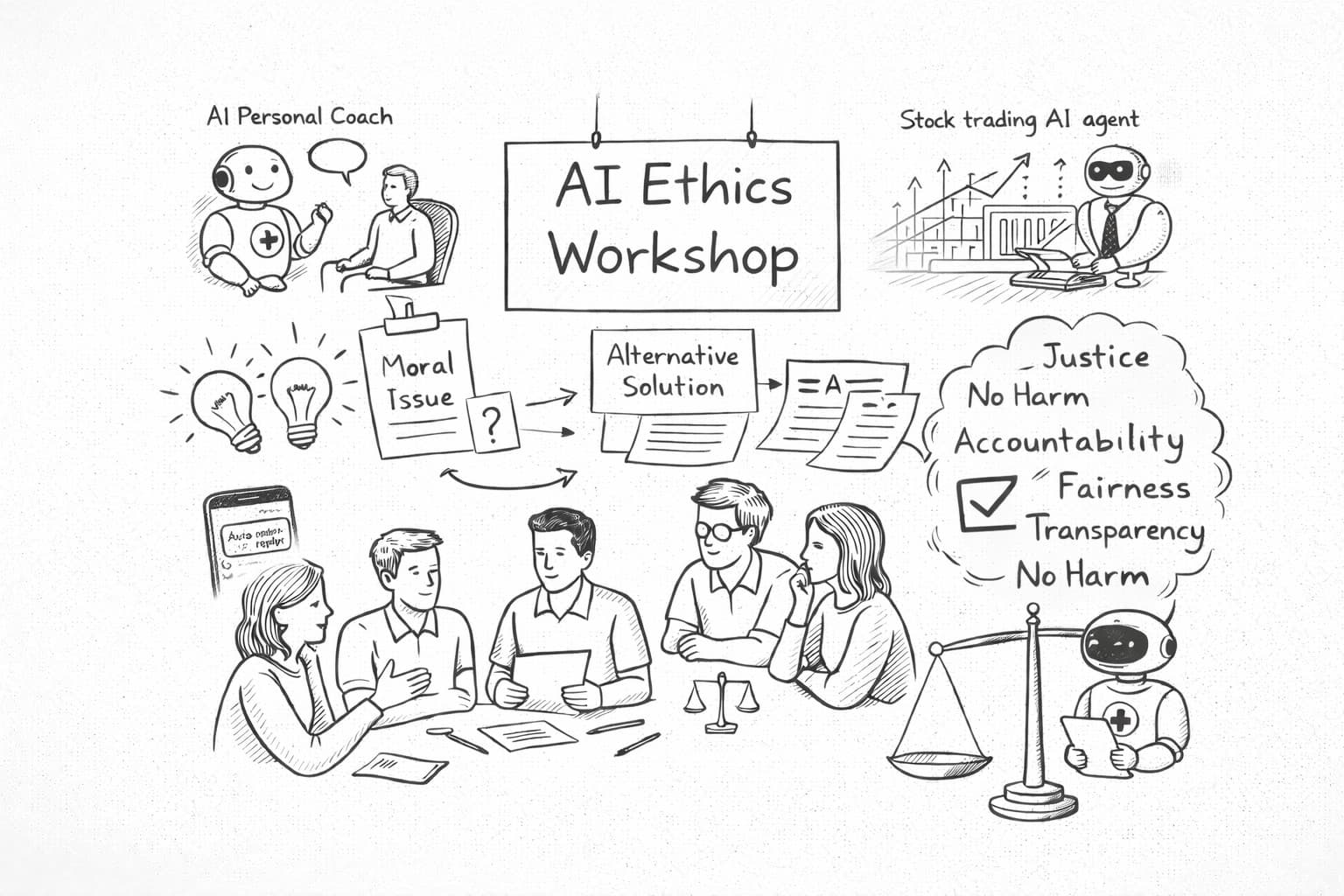

Denne workshop præsenterer en pragmatisk tilgang til etiske dilemmaer i AI.

Udgangspunktet er, at etiske udfordringer sjældent opstår som klare teorispørgsmål, med veldefinerede handlemuligheder, men opstår midt i konkrete designvalg, produktbeslutninger og tekniske kompromiser, eller i en uforudset anvendelse, måske misbrug af en AI baseret app, udviklet alene med gode hensigter.

Derfor arbejder vi ikke kun med begrundelser og argumenter, men også med moralsk fantasi og kreativ problemløsning: evnen til at forstå og definere det moralske problem, forestille sig alternative løsninger, konsekvenser og ansvarlige måder at balancerer værdier i design af AI baserede systemer.

Deltagerne introduceres til denne tilgang gennem cases fra virkelige AI-projekter. Vi analyserer konkrete situationer hvor teams må navigere mellem hensyn som retfærdighed, gennemsigtighed, innovation, sikkerhed og ansvar.

EU’s AI-forordning - Og lovgivning som moralsk værktøj

EU's AI-forordning påvirker enhver organisation der anvender AI i Europa. Opgaven er at omsætte reglerne til praktisk arbejde i hverdagen – fra at vurdere risici og dokumentere løsninger til at sikre gennemsigtighed og løbende holde øje med, hvordan systemerne fungerer.

Lovgivningens krav til menneskeligt tilsyn, gennemsigtighed og ansvarlighed er ikke blot juridiske forpligtelser — de afspejler de samme epistemiske og etiske principper, der udforskes tidligere i workshoppen. Deltagerne går derfra inspireret og bedre rustet til at arbejde med AI Governance og compliance i deres egen organisation. Workshoppen giver indblik i AI-forordningens centrale krav samt eksempler på tekniske og organisatoriske tilgange til at håndtere compliance i praksis.